Hintergrund: Generative KI bietet Potenzial – nur wie startet man am besten?

Die Flexus AG ist ein Würzburger Unternehmen, das sich auf die Optimierung intralogistischer Prozesse in SAP spezialisiert hat. Ihren Kunden bietet Flexus in Form ihrer 360° Logistics Suite SAP Add-Ons, um ihren Materialfluss zu optimieren. Das Technik-Team nimmt Anfragen zu ihren Lösungen entgegen und unterstützt Mitarbeiter bei der Problemlösung. Alles Wichtige zur Software ist in einem Wiki dokumentiert, auf welches das Technik-Team zurückgreifen kann.

Flexus kam auf die Idee, ihren Mitarbeitern und ihrer Technikabteilung durch einen KI-basierten Chatbot das Leben noch einfacher zu machen. Flexus hat selbst hoch-qualifizierte Software-Entwickler mit viel technischem Know-how, die nur selbst noch nicht in der Tiefe mit generativer KI in Berührung gekommen sind. Sie erhoffen sich daher, von prognostica einen Hands-on-Kickstart in das Thema “generative KI” zu bekommen, um sich anschließend selbst in die Entwicklung stürzen zu können. Dabei war ihnen die Verwendung von Open-Source-LLMs wichtig, um die Modelle intern hosten zu können, und so die volle Kontrolle über Modellversionen, Daten und Rechenkosten zu haben.

“Wir sehen in generativer KI eine Chance, unsere Software-Lösungen noch bedienerfreundlicher und innovativ zu gestalten. Wir wussten nur nicht, wie wir konkret starten sollten.” – Flexus AG

Ziele und Anforderungen

- Leichter und intuitiver Zugang zu Software-Dokumentation für Entwickler und Software-Berater

- KI-basierter Chatbot unter Verwendung eines Open-Source-LLMs

- Beratung zum Live-Betrieb der Lösung

- Beratung zum Aufbau einer technischen Infrastruktur

- Enablement des Entwickler-Teams in Deployment, Pflege und Anwendung von GenAI-basierten Lösungen

Lösung

“Es gibt viele Unternehmen, die ausgefeilte Excel-Kalkulationen schon als KI bezeichnen. Was wir mit prognostica gemacht haben, das verdient wirklich das Label KI.” – Flexus AG

Vorgehen

Uns war wichtig, mittels eines agilen Vorgehens schnell zu einem ersten Prototyp zu gelangen, der künstliche Intelligenz für Flexus erlebbar machte. Denn bei der Arbeit mit echten Daten ist nicht immer alles exakt im Vorfeld planbar. Durch intensive Gespräche mit Flexus erwuchs ein gemeinsames Verständnis und entstanden konkrete Vorstellungen wo es hingehen könnte.

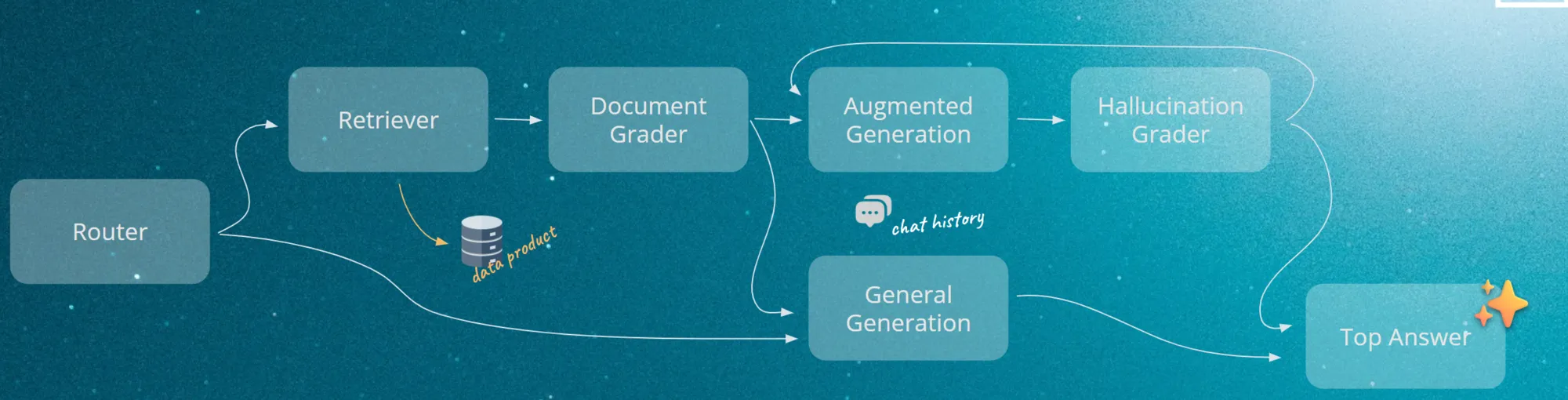

Der erste prototypische Chatbot WIKInger stand innerhalb weniger Tage: Damit konnte Flexus das eigene Wiki befragen. Der Chatbot basierte auf einer RAG-Pipeline (RAG = Retrieval Augmented Generation), bei der ein passendes Open-Source-LLM mit unternehmensspezifischem Kontext angereichert wurde, um Fragen zu Flexus’ Software-Dokumentation beantworten zu können. Diesen Chatbot konnte Flexus nun testen sowie Erfahrungen und Feedback mit uns teilen. Sukzessive haben wir so gemeinsam für problematische Fälle eine Lösung gefunden, den Chatbot mit einer individuellen Tonalität und Quellenangaben versehen und weitere Anforderungen umgesetzt. Beispiele: Der Chatbot sollte Flexus’ spezifisches Fachvokabular kennen und er sollte mit den in Tabellenform abgelegten Informationen umgehen können.

Viele Aspekte spielen eine Rolle, wenn es darum geht, aus einem Prototypen eine stabile Applikation zu machen. So haben wir Flexus darin beraten, wie Daten, Kontext und Chatbot synchronisiert gehalten werden können, sodass der Chatbot immer auf neueste Informationen im Wiki zurückgreifen kann. Zudem sollte er in der Lage sein, Feedback von den Nutzern zu den gegebenen Antworten einzusammeln, um die Relevanz und Qualität der Antworten immer weiter zu erhöhen. Mit unserer Hilfe hat Flexus außerdem die Fähigkeiten erlangt, jederzeit die zugrundeliegenden LLM-Modelle zu updaten und durch Alternativen zu ersetzen. Auch Role-based Security war ein Thema: Wie kann sichergestellt werden, dass nur Personen mit entsprechender Berechtigung auf gewisse Informationen zugreifen können?

Um solche Chatbots im operativen Betrieb in-house hosten zu können, benötigte Flexus zudem ein passendes und stabiles MLOps- und IT-Framework als Basis. Wir haben die Entwickler von Flexus daher dabei unterstützt, eine passende Grafikkarte auszuwählen, passende Pipelines einzurichten und das komplette Framework inkl. Kubernetes-Cluster, Authentifizierungsmöglichkeiten und User-Frontend zum Laufen zu bringen.

Die Schritte in Kürze

- Workshops und Datenübernahme:

- Workshops zur Einführung in LLMs, RAG und Co.

- Workshops, um Anforderungen an die Lösung gemeinsam herauszuarbeiten und Ziele für das Projekt abzustecken

- Übernahme von Datenauszügen als Ausgangsbasis für eine Beispiellösung und für das Enablement rund um LLMs

- Experimente und Prototyping:

- Auswahl eines passenden Open-Source-LLMs für den Anwendungsfall

- Anwendung von RAG zur Anreicherung des LLMs um unternehmensspezifischen Kontext

- Bereitstellung einer Chat-Oberfläche

- Individualisierte Tonalität mit Angabe von Quellen

- Entwurf und Umsetzung einer passenden technischen Infrastruktur

- Beratung zum Live-Betrieb, LLMOps-Setup und Enablement:

- Aufbau eines passenden MLOps- und IT-Frameworks

- Übergabe der Lösung und Schulung der Entwickler darin, die Lösung zu maintainen und selbst ähnliche Lösungen bauen zu können

Ergebnis: nachhaltiges Enablement für langfristigen Erfolg mit KI

Flexus hat mit dem WIKInger einen LLM-basierten Chatbot, der ihrem Technik-Team ermöglicht, noch kundenfreundlicher auf Anfragen der Mitarbeiter zu reagieren – schneller, präziser und unter Angabe von Quellen zu den genannten Informationen. Außerdem dient die Lösung als Blueprint für weitere LLM-basierte Lösungen, die Flexus in der Folge selbst bauen kann.

Durch die Nutzung von Open-Source-LLMs ist Flexus unabhängig von einem einzelnen Player im Bereich der generativen KI und hat die volle Kontrolle über Modellversionen, Daten und Kosten im Bereich sensibler Daten.

“Wir finden uns in der Welt der LLMs nun sehr gut zurecht und sind dank prognostica in der Lage, selbst Chatbots zu bauen und LLMs zu hosten.” – Flexus AG

Das Projektteam

Manuel

Senior Data Scientist

André

Data Scientist

Möchten auch Sie einen Hands-on-Quickstart in LLMs und generativer KI erfahren? Dann

gerne und wir vereinbaren einen ersten Online-Termin.